深度持续学习中的可塑性丧失:挑战、机制与解决方案

摘要

人工神经网络、深度学习方法和反向传播算法是现代机器学习与人工智能的基石。然而,这些强大的工具在需要持续适应新数据的场景中却面临严峻挑战。本文深入探讨了《自然》杂志近期发表的一项研究(Dohare et al., 2024),该研究系统性地揭示了标准深度学习方法在持续学习(Continual Learning, CL)环境中会逐渐丧失“可塑性”(Plasticity),即学习新知识的能力,最终表现甚至不如浅层网络。研究通过经典的 ImageNet 数据集和强化学习任务,在多种网络结构和学习算法上验证了这一现象。文章指出,只有那些能够持续向网络注入多样性的算法,例如研究者提出的“持续反向传播”(Continual Backpropagation)算法,才能无限期地维持可塑性。持续反向传播通过随机重新初始化一小部分使用频率较低的单元来实现这一点。这项研究的核心结论是:仅仅依赖梯度下降不足以实现持续的深度学习,需要引入随机的、非梯度的成分来维持网络的可变性和可塑性。

1. 引言:深度学习的辉煌与持续学习的困境

过去十年,深度学习在自然语言处理、生物学、游戏(如围棋、实时策略游戏)、机器人学等领域取得了里程碑式的成功。这些成就主要归功于大型、深度分层的人工神经网络以及基于随机梯度下降(SGD)和反向传播(Backpropagation)的训练方法。强大的计算能力和不断优化的训练技术使得这些经典思想在现代得以大放异彩。

然而,当前的深度学习范式存在一个显著的局限性:它难以适应动态变化的数据流。绝大多数应用遵循“训练-部署”模式,即在一个大规模通用数据集上进行训练(有时会针对特定应用进行微调),然后冻结网络权重进行实际使用。当新数据不断涌现时,简单地在现有模型上继续训练通常效果不佳——新数据的影响可能过大(覆盖旧知识)或过小(无法有效学习),难以与旧知识平衡。实践中,最常见的策略是丢弃旧模型,在新旧数据混合的数据集上从头开始重新训练。对于大型模型(如大型语言模型),每次重新训练都意味着数百万美元的计算成本。

与此形成对比的是,自然学习系统(如人脑)以及众多现实世界应用(如市场预测、用户偏好学习、游戏、物流、控制系统)都要求系统具备持续学习的能力,即在不遗忘旧知识的前提下不断适应新信息。如果深度学习系统能像生物系统一样进行持续学习,其应用潜力将得到极大拓展。

本文聚焦于深度学习在持续学习环境下面临的一个核心障碍——可塑性丧失(Loss of Plasticity)。这一现象指的是随着训练的进行,网络学习新任务或适应新数据的能力逐渐下降。需要明确的是,这与“灾难性遗忘”(Catastrophic Forgetting)不同,后者关注的是即使旧数据不再出现,模型在旧任务上的表现也会急剧下降。可塑性丧失则更侧重于学习新知识能力的退化。

2. 揭示可塑性丧失:来自监督学习的证据

为了令人信服地证明标准深度学习方法存在可塑性丧失,研究者进行了系统性、大规模的实验,涵盖了多种网络架构、学习算法和参数设置。由于研究所需的计算量远超单次网络训练(约高出3-4个数量级),研究者选用了经典的、相对计算可行的基准测试,如 ImageNet 和 CIFAR-100。

2.1 持续 ImageNet(Continual ImageNet)实验

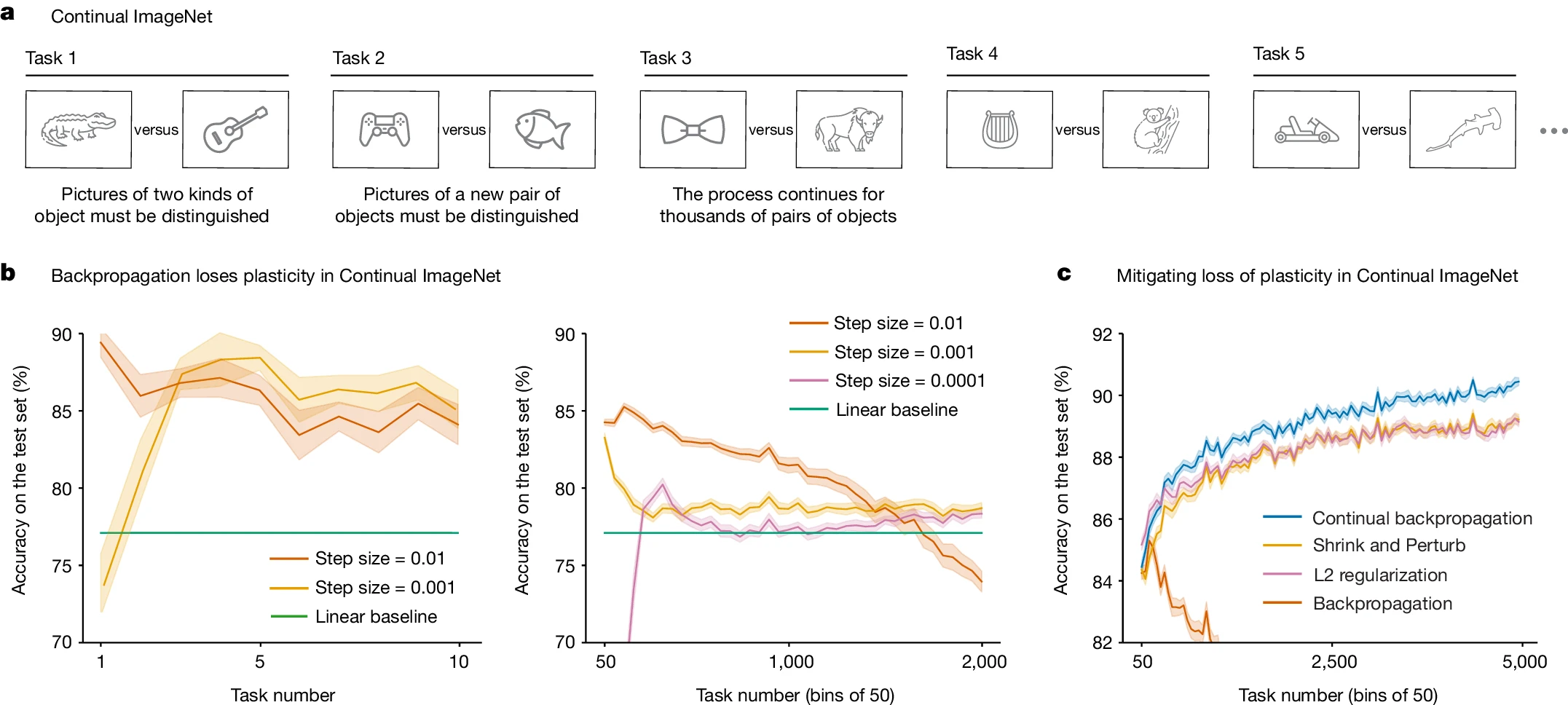

ImageNet 是一个包含数百万张标注图像的大型数据集,在深度学习发展史上起到了关键作用。为了将其改造为持续学习场景,研究者构建了一系列二元分类任务。他们从 ImageNet 的 1000 个类别中每次抽取两个类别,形成一个独立的二元分类子任务(例如,区分“猫”和“房子”,然后区分“停止标志”和“校车”)。对于每个任务,网络首先在对应两个类别的训练子集上进行训练,然后在测试子集上评估其分类准确率。完成一个任务后,网络接着处理下一个由不同类别对构成的新任务。

这种“持续 ImageNet”设置的关键在于,所有任务的内在难度是相似的。因此,如果网络在后续任务上的性能下降,这直接反映了其学习能力的衰退,即可塑性丧失。

研究中测试了多种标准的深度学习网络(如前馈卷积网络)和学习算法。图 1b 展示了使用标准反向传播算法的典型结果。

- 观察: 如图 1b 所示,对于一个在初始任务上表现良好的网络(早期任务测试准确率高达 88%),经过大约 2000 个任务后,无论使用何种步长(学习率)参数,其可塑性都显著下降。某些步长设置在初期表现优异,但随后性能急剧恶化,最终甚至低于简单的线性网络(即只有一个可学习层的网络)基线。其他步长设置下,性能可能先有所上升,然后持续下降,最终也仅略好于线性基线。

- 结论: 这种“先升后降,最终趋近或低于线性基线”的模式在各种网络架构、参数选择和优化器(如 SGD with Momentum)的实验中普遍存在。这有力地证明了标准深度学习方法在长期持续学习任务中会丧失学习能力。

图 1: 持续 ImageNet 中的可塑性丧失

(a) ImageNet 图片构成的二元分类任务序列示意图。

(b) 传统反向传播算法在所有步长设置下均表现出可塑性丧失。随着任务数量增加,测试准确率下降。

(c) 持续反向传播(Continual Backpropagation)、L2 正则化和 Shrink and Perturb 算法能够维持甚至提升可塑性。

与之相对,一些明确旨在控制网络权重大小的算法表现出了维持可塑性的能力(图 1c):

- L2 正则化: 通过在损失函数中加入权重 L2 范数的惩罚项,阻止权重过大。实验表明,加入 L2 正则化的反向传播能够使网络在至少 5000 个任务中持续提升学习性能。

- Shrink and Perturb: 该算法结合了 L2 正则化(Shrink)和在每步对权重添加微小随机扰动(Perturb)。它也表现良好,维持了可塑性。

- 持续反向传播 (Continual Backpropagation, CBP): 这是研究者提出的新算法,表现最佳。我们将在后面详细讨论。

2.2 类增量 CIFAR-100(Class-Incremental CIFAR-100)实验

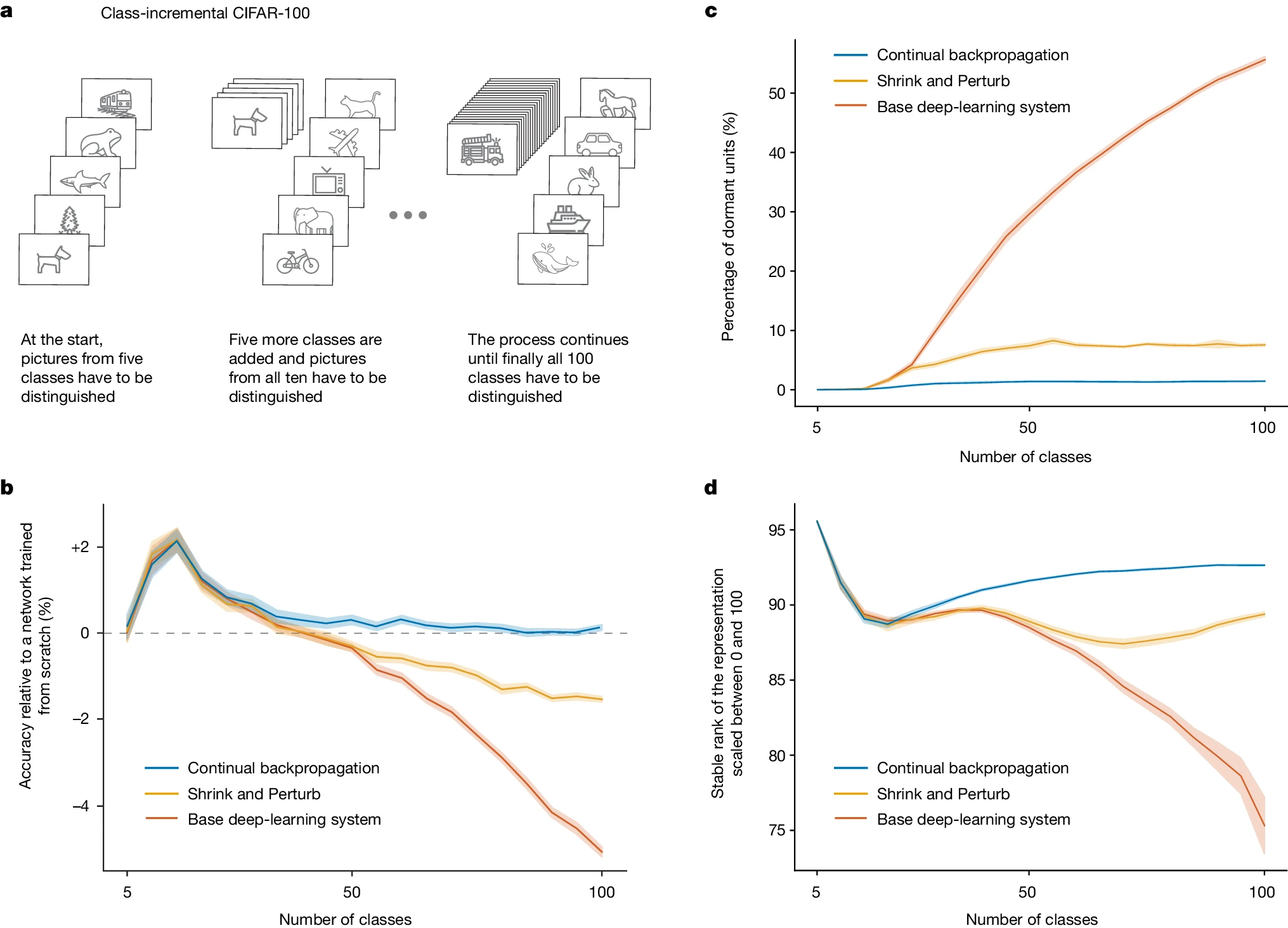

为了在更现代的网络架构和不同的持续学习范式下验证结论,研究者使用了 CIFAR-100 数据集、类增量学习设置和残差网络(Residual Networks, ResNets)。

- 设置: ResNets 包含跳跃连接,是当前广泛使用且性能优越的网络结构。类增量学习是指系统按顺序学习新的类别,同时需要保持对所有已见类别的识别能力。实验中,网络从 5 个类别开始,每次增加 5 个新类别,直至学习完所有 100 个类别。每次增加类别后,网络都在当前所有可见类别的数据上进行训练,并在这些类别的测试集上评估性能。重要的是,与许多类增量学习研究不同,这里网络会持续在旧类别上训练,目的是聚焦于可塑性而非遗忘问题。

- 评估: 随着类别数量增加,分类任务本身难度加大,即使学习能力不变,准确率也可能下降。为了剥离任务难度增加的影响,研究者将增量训练的网络性能与一个在相同类别子集上从头重新训练(Retrained from Scratch)的网络性能进行比较。如果增量训练的网络性能优于从头训练的网络,说明利用了过去的学习经验;如果劣于从头训练的网络,则表明发生了真正的可塑性丧失。

- 基线系统: 使用了包含 Batch Normalization、数据增强、L2 正则化和学习率调度等标准技术的 18 层 ResNet。

图 2: 类增量 CIFAR-100 中的可塑性丧失

(a) 类增量图像分类问题示意图。

(b) 性能比较:横轴为学习到的类别数,纵轴为相对于“从头训练”基线的准确率差异。红色(Base deep learning system)显示,初期增量训练有优势,但超过 40 类后性能显著下降(可塑性丧失)。橙色(Shrink and Perturb)有所改善。蓝色(Continual backpropagation)几乎完全消除了可塑性丧失。

(c) 不活跃单元比例:Base 系统中不活跃(激活频率<1%)单元比例随任务增加而快速上升,S&P 和 CBP 系统则有效抑制了这一现象。

(d) 稳定秩(Stable Rank):衡量网络层表示多样性的指标。Base 系统稳定秩下降明显,表明表示多样性丧失,而 S&P 和 CBP 系统保持了较高的多样性。

- 观察与结论: 如图 2b 所示(红线),基础深度学习系统在初期(少于 40 类时)表现优于从头训练,表明存在知识迁移。但随着类别增多,其性能相对下降,到 100 类时,准确率比从头训练低了 5%,相当于移除 Batch Normalization 这种重要技术带来的性能损失。这再次证实了可塑性丧失。Shrink and Perturb 减轻了这种损失(橙线),而持续反向传播(蓝线)则完全消除了它。

- 内在机制: 图 2c 和 2d 揭示了潜在原因。在基础系统中,大量网络单元变得不活跃(“死亡单元”),并且网络表示的“稳定秩”(衡量表示多样性的指标)显著下降。这意味着网络的内部表示变得越来越冗余和僵化。Shrink and Perturb 和 CBP 则能有效维持单元的活跃度和表示的多样性。

这些在不同数据集、网络结构和持续学习范式下的监督学习实验结果共同构成了强有力的证据,表明标准深度学习方法在持续学习中存在普遍的可塑性丧失问题。

3. 强化学习中的可塑性丧失:更严峻的挑战

持续学习对于强化学习(Reinforcement Learning, RL)尤为重要,甚至超过了监督学习。在 RL 中,不仅环境可能随时间变化,智能体自身的行为(策略)也会在学习过程中改变,这反过来又影响它接收到的数据,即使环境本身是静态的。因此,RL 天然地需要持续适应。

然而,在 RL 中系统性地证明可塑性丧失更具挑战性:

- 算法多样性: RL 算法种类繁多(学习价值函数、策略或两者兼有;使用经验回放、世界模型、学习潜在状态等),每种都有复杂的参数设置。

- 数据与学习耦合: RL 算法通过与环境交互产生数据,学习能力与其探索和生成信息性数据的能力相互影响,难以解耦。

- 随机性与变异性: RL 结果通常比监督学习具有更大的随机性和波动性。

尽管存在这些挑战,研究者还是设计了实验来检验深度 RL 中的可塑性。

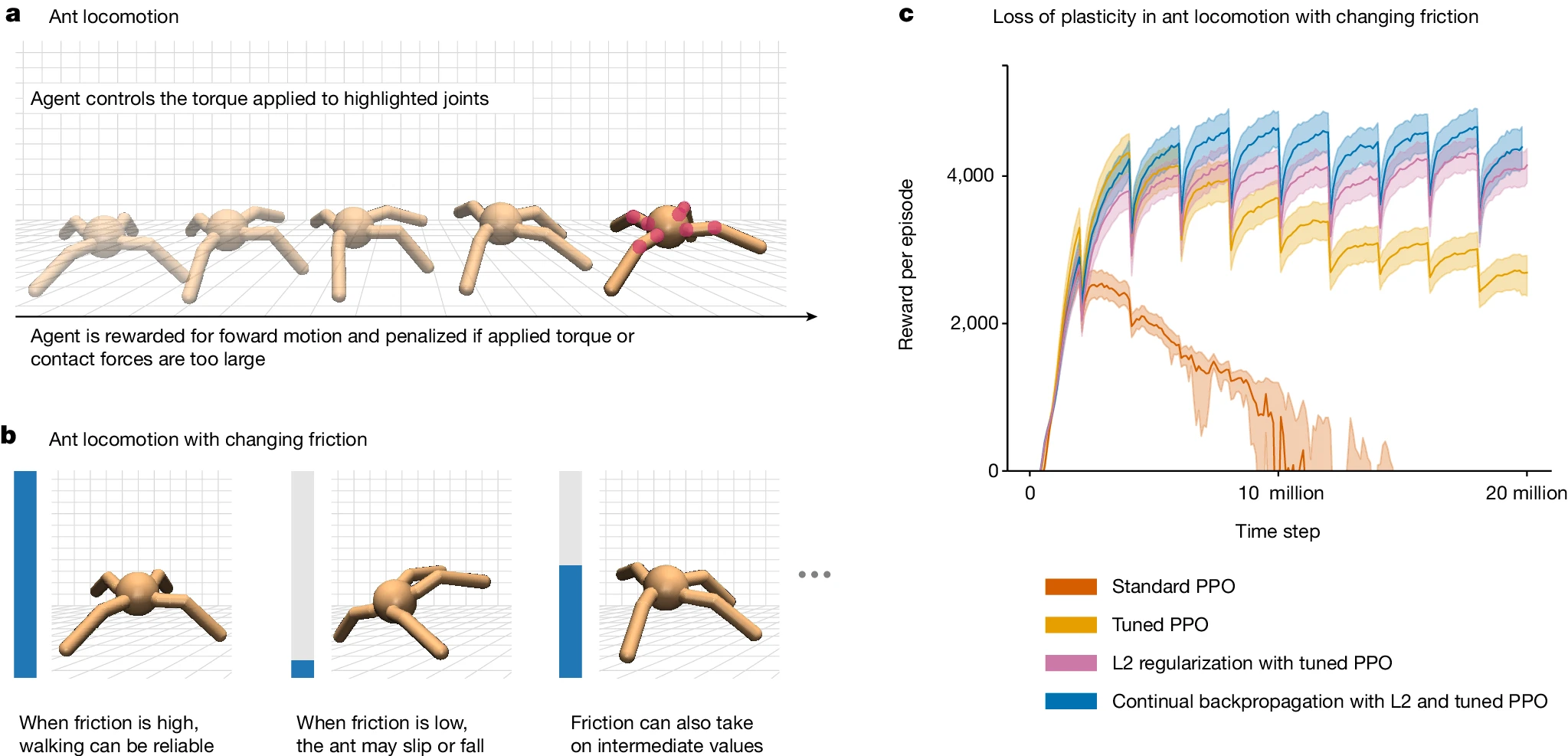

3.1 非稳态环境下的 Ant 机器人运动

- 任务: 模拟一个蚂蚁型机器人,目标是尽可能快且高效地向前移动。智能体通过控制 8 个关节的力矩与环境交互。每个交互回合(episode)从标准状态开始,最多持续 1000 个时间步。智能体每步获得奖励,奖励与前进距离正相关,与动作幅度负相关。如果蚂蚁跳得太高(早期学习常见),回合提前结束。

- 非稳态设置: 为了强调可塑性需求,研究者引入了非稳态因素:蚂蚁足部与地面之间的摩擦系数每隔 200 万个时间步(仅在回合边界)会发生一次突变(从 [0.02, 2.0] 区间内对数均匀采样)。智能体必须在每次摩擦系数变化后重新学习最佳行走方式。

- 算法: 使用了近端策略优化(Proximal Policy Optimization, PPO),这是一种广泛应用于机器人控制、实时策略游戏和大型语言模型对齐的标准深度 RL 算法。

图 3: 非稳态强化学习问题中的可塑性维持

(a) RL 智能体控制模拟蚂蚁的 8 个关节力矩(红圈)。

(b) 实验设置:地面摩擦系数每 200 万步突变一次。

(c) 性能曲线(回合累积奖励 vs. 时间步):标准 PPO(红色)在第一次摩擦变化后性能急剧下降且无法恢复。特别调优的 Adam 优化器(橙色,Tuned PPO (Adam))表现更好,但在多次变化后仍显著恶化。添加 L2 正则化(紫色)或持续反向传播(蓝色,与少量 L2 结合)的 PPO 则能基本维持可塑性,在摩擦变化后快速适应。

- 观察与结论: 如图 3c 所示,标准 PPO(红线)在第一个 200 万步内学习良好,但在第一次摩擦系数改变后,性能急剧下降且无法恢复。后续的摩擦变化进一步加剧了性能恶化。即使使用了针对 RL 稳定性进行特别调优的 Adam 优化器(橙线,β1=β2=0.99,避免标准 Adam 的动量估计问题),虽然表现远好于标准 PPO,但在经历多次环境变化后,其适应能力仍然明显下降,显示出显著的可塑性丧失。相比之下,增加了 L2 正则化的 PPO(紫线)和增加了持续反向传播(结合少量 L2 正则化以提高稳定性)的 PPO(蓝线)则能够较好地维持可塑性,在每次摩擦变化后性能虽有下降但能迅速恢复。

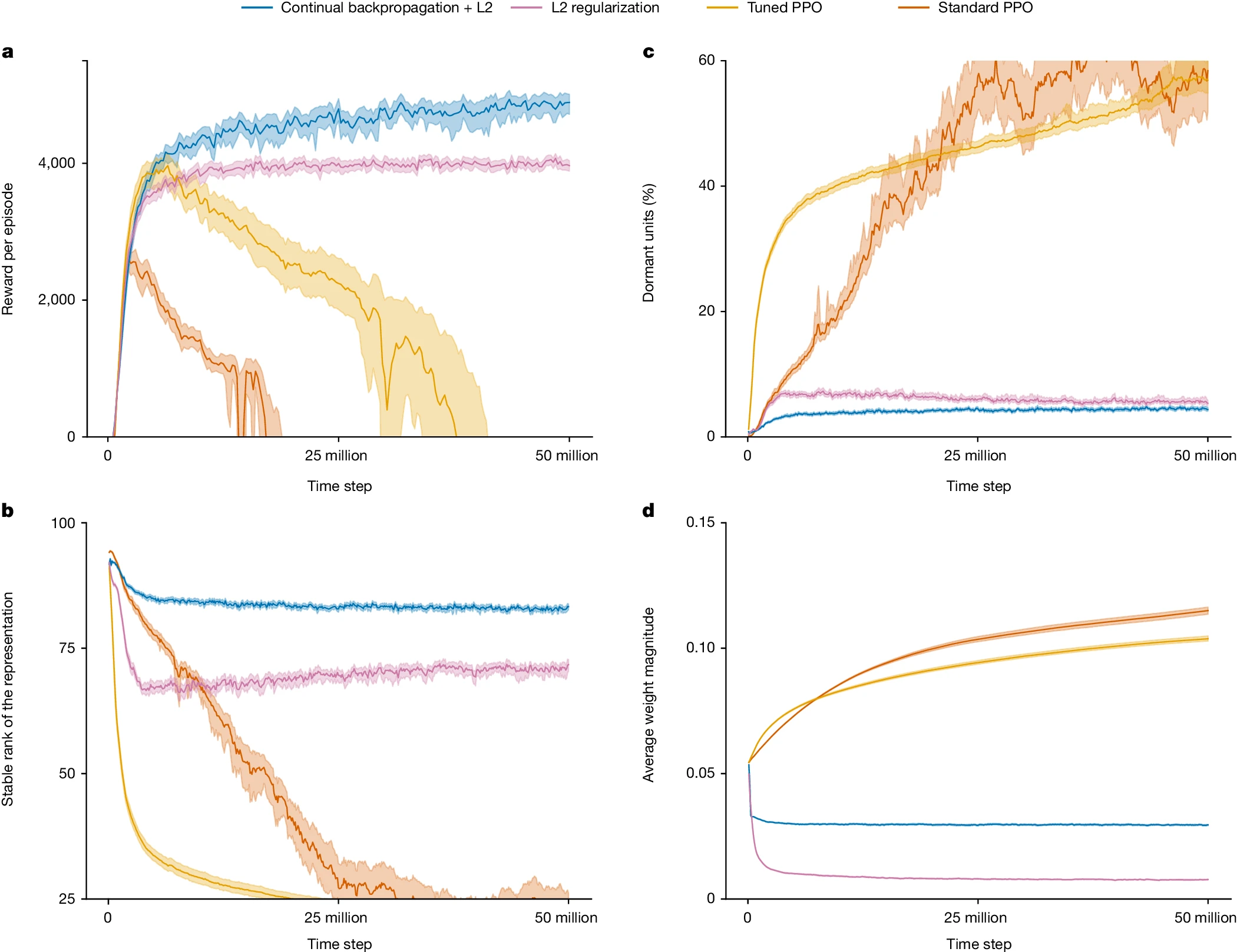

3.2 稳态环境下的 Ant 机器人运动

为了进一步探究可塑性丧失的内在机制,研究者还在摩擦系数恒定(中等值)的条件下,让 PPO 算法运行了更长时间(5000 万步)。

图 4: 稳态 Ant 运动问题结果

(a) 性能曲线:标准 PPO(红色)性能在约 300 万步达到峰值后开始崩溃,2000 万步后完全无法学习。Tuned PPO(橙色)崩溃较晚但仍发生。L2(紫色)性能稳定但次优。CBP+L2(蓝色)持续改进。

(b) 不活跃单元比例:PPO 和 Tuned PPO 的不活跃单元比例急剧上升。L2 和 CBP+L2 保持较低水平。

(c) 稳定秩:PPO 和 Tuned PPO 的稳定秩显著下降。L2 和 CBP+L2 维持较高水平。

(d) 平均权重绝对值:PPO 和 Tuned PPO 的权重持续增长。L2 权重变得非常小。CBP+L2 的权重保持稳定。

- 观察与结论: 如图 4a 所示,标准 PPO(红线)的平均性能在学习约 300 万步后开始灾难性地崩溃,到 2000 万步时,智能体在每个回合都失败,完全丧失了学习前进的能力。Tuned PPO(橙线)推迟了崩溃的时间,但最终也未能幸免。图 4b-d 揭示了与监督学习类似的内在变化:

- 单元失活: 标准 PPO 和 Tuned PPO 中,大量网络单元变得不活跃(图 4b)。

- 多样性丧失: 网络表示的稳定秩显著下降(图 4c)。

- 权重增长: 网络权重的平均绝对值持续增大(图 4d)。

- 对比不同方法:

- L2 正则化(紫线): 阻止了权重的持续增长(图 4d),缓解了性能崩溃,但也导致权重过小,限制了智能体学习到最优策略(图 4a 性能 plateau 在次优水平)。

- 持续反向传播 + L2(蓝线): 表现最好。它不仅维持了低比例的失活单元(图 4b)和高稳定秩(图 4c),还保持了适中的权重大小(图 4d),使得智能体能够持续改进性能(图 4a)。

这些 RL 实验结果表明,可塑性丧失问题在深度 RL 中同样存在,甚至可能导致灾难性的学习失败。并且,其内在机制(单元失活、多样性丧失、权重行为异常)与监督学习中观察到的现象高度一致。

4. 理解可塑性丧失的机制:多样性的消逝

为什么标准的反向传播会在持续学习中丧失可塑性?研究者分析了网络在训练过程中的内部变化,发现可塑性丧失与以下几个现象密切相关:

单元的“死亡”或“饱和”(Dormancy/Saturation):

- 机制: 在使用 ReLU 激活函数的网络中,如果一个单元的输入持续为负,其输出将恒为零,梯度无法反向传播通过该单元,导致其输入权重停止更新——该单元“死亡”。对于 Sigmoid 或 Tanh 等饱和型激活函数,如果单元输出长时间接近其饱和区(如接近 0 或 1),其梯度也会变得极小,同样失去学习能力——单元“饱和”。

- 影响: 大量单元死亡或饱和会降低网络的有效容量,限制其表达能力和学习新模式的能力。

- 证据: 实验(如 Permuted MNIST, CIFAR-100, Ant)中观察到,随着可塑性丧失,死亡/不活跃单元的比例显著增加(图 2c, 4b, Extended Data Fig. 3c)。

权重过度增长(Weight Growth):

- 机制: 在没有正则化的情况下,梯度下降过程可能导致网络权重持续增大。

- 影响: 过大的权重可能导致损失函数的 Hessian 矩阵条件数过大,使得优化过程对学习率更加敏感,收敛变慢,甚至不稳定。虽然直接联系尚需深入研究,但实验观察到权重增长与可塑性丧失同时发生(图 4d, Extended Data Fig. 3c)。L2 正则化通过抑制权重增长,确实在一定程度上缓解了可塑性丧失。

- 证据: 在 Ant 实验和 Permuted MNIST 实验中,标准方法下的权重持续增长与性能下降相关。

表示多样性的丧失(Loss of Representational Diversity / Stable Rank Reduction):

- 机制: 稳定秩(Stable Rank)是衡量矩阵(在此指网络层的激活矩阵或权重矩阵)有效维度的指标。高稳定秩意味着层的各个单元(或特征维度)贡献相对均衡且信息丰富。低稳定秩则表示层的大部分信息集中在少数几个主导维度上,存在大量冗余或近似线性的依赖关系。研究发现,随着持续训练,网络隐藏层的稳定秩趋于下降。

- 影响: 低稳定秩意味着网络的内部表示变得“僵化”和“缺乏多样性”。当面临新任务或数据分布变化时,这样一个缺乏灵活性的表示可能难以适应,因为它缺乏足够的“自由度”来编码新的信息。优化算法可能陷入一个对当前任务来说是局部最优但对未来任务适应性差的低秩解。

- 证据: 在 CIFAR-100 和 Ant 实验中,基础系统的稳定秩随着可塑性丧失而显著下降(图 2d, 4c, Extended Data Fig. 3c)。

核心观点: 网络初始时随机初始化的权重具有天然的多样性(单元功能各异、权重小、表示秩高)。标准的反向传播在优化当前任务时,倾向于牺牲这种多样性,导致单元死亡、权重增长(或固化)、表示冗余。这种多样性的逐渐丧失,正是可塑性丧失的根本原因。网络失去了探索新解决方案空间的能力。

5. 维持可塑性的策略:注入持续的多样性

既然可塑性丧失源于多样性的消逝,那么维持可塑性的关键就在于持续地向网络中注入多样性,并控制权重规模。

5.1 现有方法的评估

研究者评估了几种常见的深度学习技术和旨在维持可塑性的方法:

效果不佳或有害的方法:

- Adam 优化器 (标准设置): 尤其是在 RL 中,默认的 Adam 参数(β1=0.9, β2=0.999)被发现会加剧可塑性丧失(Extended Data Fig. 4a, 5c)。这可能与其动量估计机制在非稳态梯度下的行为有关,容易产生过大的权重更新。调优后的 Adam (β1=β2) 表现更好,但仍不如专门设计的可塑性维持方法。

- Dropout: 这种常用的正则化技术,在持续学习场景下,反而可能加剧可塑性丧失(Extended Data Fig. 4a)。原因尚不完全清楚,但可能与它随机丢弃单元的方式干扰了持续学习所需的信息积累有关。

- Normalization (Batch/Online): 虽然在标准训练中极为有效,但在持续学习的长期运行中,也可能导致更严重的可塑性丧失(Extended Data Fig. 4a)。

部分有效的方法:

- L2 正则化: 通过惩罚大权重,有效控制了权重增长,从而在一定程度上维持了可塑性(图 1c, 3c, 4a, Extended Data Fig. 4a)。但它本身不主动增加多样性,且可能过度抑制权重,导致性能次优(图 4a)。

- Shrink and Perturb: 结合了 L2 正则化和全局权重扰动。扰动部分为网络注入了随机性,有助于激活“死亡”单元,提高表示多样性。它比单纯 L2 效果更好(图 1c, 2b, Extended Data Fig. 4a),但全局扰动可能不够精确,且对超参数(如噪声方差)较为敏感。

5.2 持续反向传播 (Continual Backpropagation, CBP)

基于“需要持续注入多样性,且最好是有选择性地注入”的理念,研究者提出了持续反向传播 (CBP) 算法。

核心思想: 模仿网络初始化的过程,但不是一次性完成,而是在整个训练过程中持续进行。关键在于选择性地重新初始化一小部分利用率最低的单元,以最小化对已学知识的破坏,同时引入新的随机性。

算法机制 (Algorithm 1):

- 效用度量 (Utility Measure): 定义一个“贡献效用”(Contribution Utility)来衡量每个隐藏单元的重要性。其基本思想是:一个单元对其下游单元的贡献大小,可以通过该单元的激活值与其输出权重的乘积幅度来近似。如果一个单元对其所有下游单元的总贡献都很小,则认为该单元效用低。效用值通常使用指数移动平均进行平滑估计(公式 1)。

u_l[i]_t = (1 - η) * u_l[i]_{t-1} + η * |h_{l,i,t}| * Σ_k |w_{l,i,k,t}|

(其中η是衰减率,h是激活,w是输出权重) - 选择性重新初始化:

- 每一步(或每小批量)计算一次单元效用。

- 确定一个小的**替换率 (ρ)**,表示每层每步预期要替换的单元比例(通常 ρ 非常小,例如 10^-5,意味着几百步才替换一个单元)。

- 在达到**成熟度阈值 (m)**(即单元已被更新 m 步以上,防止新初始化的单元被立即替换)的单元中,选择效用最低的单元进行重新初始化。

- 重新初始化过程:

- 将选中单元的输入权重重新从初始分布中采样(例如 Kaiming 初始化)。

- 将其输出权重初始化为零。这确保了新单元在刚开始时不影响网络现有输出,给它一个“学习适应”的机会。

- 重置该单元的年龄和效用。

- 结合梯度下降: CBP 的每一步都包含标准的梯度下降(更新所有权重)和上述的选择性重新初始化过程。

- 效用度量 (Utility Measure): 定义一个“贡献效用”(Contribution Utility)来衡量每个隐藏单元的重要性。其基本思想是:一个单元对其下游单元的贡献大小,可以通过该单元的激活值与其输出权重的乘积幅度来近似。如果一个单元对其所有下游单元的总贡献都很小,则认为该单元效用低。效用值通常使用指数移动平均进行平滑估计(公式 1)。

性能表现:

- 在 Continual ImageNet 上,CBP 表现优于 L2 和 Shrink and Perturb,有效维持了可塑性(图 1c)。

- 在 Class-Incremental CIFAR-100 上,CBP 完全克服了可塑性丧失,保持了低比例的死亡单元和高稳定秩(图 2b, c, d)。

- 在 RL 任务中(与少量 L2 结合使用),CBP 显著改善了 PPO 的性能,无论是在非稳态(图 3c)还是稳态(图 4a)环境下,都维持了良好的学习能力和适应性,并保持了健康的内部网络状态(图 4b, c, d)。

优势分析: CBP 相较于 Shrink and Perturb 的优势在于其选择性。它只扰动(重新初始化)那些当前看来作用不大的单元,最大限度地保留了网络中已有的有用结构,同时精确地在“需要的地方”注入了多样性。这种“变异与选择”(在单元空间)与梯度下降相结合的方式,被证明是维持深度网络长期可塑性的有效途径。

6. 讨论与未来展望

- 核心结论重申: 标准深度学习方法(基于反向传播和梯度下降)在需要持续学习的环境中会因逐渐丧失可塑性而失效。这种损失与网络内部多样性(单元活跃度、表示秩、权重特性)的退化密切相关。

- 解决方案方向: 维持可塑性需要超越单纯的梯度下降,引入能够持续注入随机性和多样性的机制。L2 正则化、Shrink and Perturb 和持续反向传播 (CBP) 提供了不同程度的解决方案,其中 CBP 的选择性机制表现尤为突出。

- 与持续学习其他目标的权衡: CL 不仅要维持可塑性(学习新知识),还要保持稳定性(不遗忘旧知识)。CBP 主要解决了可塑性问题。未来的工作需要开发能够同时平衡稳定性和可塑性的方法。例如,可以改进 CBP 的效用度量,使其考虑单元的历史重要性,以避免遗忘关键的旧知识。

- 与相关领域的联系:

- 动态稀疏训练 (Dynamic Sparse Training): 与 CBP 类似,也涉及连接的生成和移除,但通常操作在连接层面而非单元层面。两者理念相通,可以相互借鉴。

- 网络扩展方法: 一些 CL 方法通过动态增加网络容量来适应新任务,但这通常没有内存上限。CBP 则旨在有限资源下维持学习能力。

- 彩票假设 (Lottery Ticket Hypothesis): 随机初始化的网络包含性能优异的“中奖子网络”。可塑性丧失可能与训练过程中这些“彩票”的减少或难以找到有关。CBP 通过持续引入随机性,可能有助于维持“彩票池”。

- 开放问题与未来方向:

- 更深入地理解初始化对于可塑性的具体作用机制。

- 统一理解优化过程中的可塑性丧失与泛化能力的可塑性丧失。

- 开发更 principled(而非启发式)的单元效用度量方法,可能借鉴网络剪枝领域的成果。

- 将 CBP 与缓解灾难性遗忘的方法相结合,构建更全面的持续学习系统。

- 探索 CBP 在更大规模模型和更复杂任务上的应用。

7. 结论

Dohare et al. (2024) 的研究有力地揭示了标准深度学习方法在持续学习场景下的一个根本性缺陷——可塑性丧失。通过系统的实验和对网络内部机制的深入分析,研究表明,维持网络内部的多样性对于保持长期学习能力至关重要。仅仅依赖梯度下降是不够的,需要引入如持续反向传播 (CBP) 这样的机制,通过受控的、持续的随机性注入来对抗多样性的自然衰减。这项工作不仅为理解深度学习的局限性提供了重要见解,也为开发真正能够像生物一样持续学习、适应动态世界的人工智能系统指明了关键方向。克服可塑性丧失是迈向更通用、更鲁棒的人工智能的重要一步。

数据与代码可用性

研究所使用的数据集和模拟环境均为公开可用。相关代码已在 GitHub 开源: https://github.com/shibhansh/loss-of-plasticity。

参考文献

- Dohare, S., Hernandez-Garcia, J. F., Lan, Q., Rahman, P., Mahmood, A. R., & Sutton, R. S. (2024). Loss of plasticity in deep continual learning. Nature, 632(7997), 768–774.

- Rumelhart, D. E., Hinton, G. E., & Williams, R. J. (1986). Learning representations by back-propagating errors. Nature, 323(6088), 533–536.